更多CG新聞

MORE CG News

Luma AI – Introducing Ray3.14

【Luma AI推出Ray3.14支援以原生1080p生成影片】

Luma Labs 為其影片生成 AI 平台「Dream Machine」推出了一款新模型「Ray3.14」!! 支援1080p, 提升影像品質和生成效率.

此新版本支援以原生 1080p 解析度生成影片, 與上一代型號(Ray3)相比, 生成速度和性價比均顯著提高、速度提升 4 倍、成本降低 3 倍,並在畫質、穩定性與動態一致性上大幅改進.

主要特色如下:

– Native 1080p:在核心 Dream Machine 工作流程中提供高解析度影片生成.

– 速度提升:在 720p 下比 Ray3 快 4 倍.

– 成本降低:在 720p 下比 Ray3 便宜 3 倍.

– Prompt adherence 更佳,生成結果更貼近文字描述,減少 artifacts.

– Modify workflow 改進:在角色、物件、風格上跨幀保持一致性.

– Modify Video 最長可達 18 秒.

Ray3.14 已在 Dream Machine 平台上提供使用!!

Adobe new AI-powered video editing tools

【Adobe更新加強後期軟件的AI處理】

Adobe 在 Sundance Film Festival 前宣布更新 – 表示該影展中 85% 的影片使用 Adobe Creative Cloud 製作.

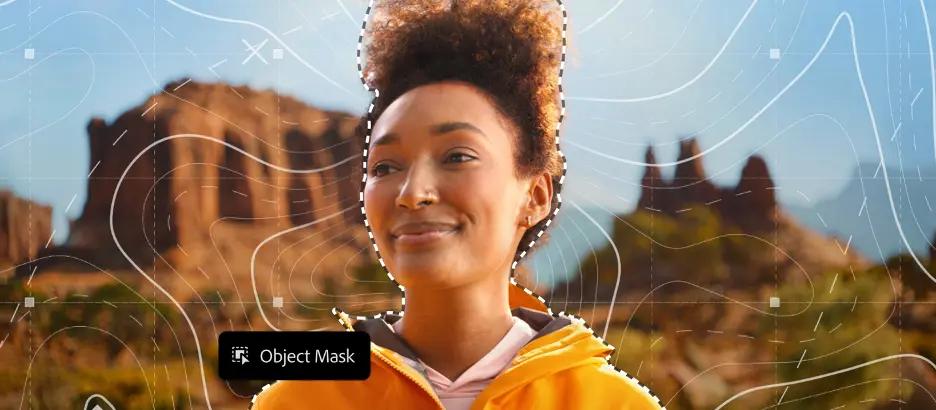

更新內容主要在 Premiere 推出 AI 遮罩工具, 顯著提升編輯效率;另外, 在 After Effects 強化 Motion Design 功能, 擴展創意表現.

Premiere 更新重點 :

– AI-powered Object Mask:只需 hover + click,即可快速生成並追蹤複雜移動物件的精準遮罩.

– Shape Masks:重新設計, 追蹤速度提升至 20× faster,讓遮罩成為創意利器.

After Effects 更新重點 :

– Typography:新增字體控制與設計強化.

– Materials & 3D:提供更豐富的材質與 3D 功能, 擴展 Motion Design 的表現力.

– 整合性提升:更直覺的工作流程, 保持創意流暢度.

Google Veo 3.1 Ingredients to Video: More consistency, creativity and control

【Google 生成影片模型 Veo 3.1 更新】

Google 推出 Veo 3.1 Ingredients to Video 更新, 提升影片生成的一致性、創意與控制力

新功能有 支援直式 9:16 輸出、1080p/4K 升級、角色與背景一致性, 以及 SynthID 水印驗證 , 重點包括 :

– 更具表現力影片生成:由 ingredient images 生成更生動的影片, 增加敘事與互動感.

– 角色一致性 (Identity consistency):同一角色可在不同場景保持外觀一致, 有助於完整敘事.

– 背景與物件一致性:場景中的物件、背景、材質可跨場景保持一致.

– 元素融合:可將角色、物件、材質與風格化背景融合成高衝擊力片段.

– Nano Banana Pro (Gemini 3 Pro Image):可用於生成 ingredient images,再搭配 Veo 3.1 轉換成影片.

增強版 Veo 3.1 Ingredients to Video 與原生 vertical format 支援, 正陸續推出至 Flow、Gemini API、Vertex AI、Google Vids;同時 1080p 與 4K resolution 選項也可在 Flow、API、Vertex AI 上使用 !!

NVIDIA at CES 2026

【話去又唔去嘅-CES2026】

在美國 CES 2026上, NVIDIA發表:Rubin 平台、開放模型、自動駕駛——NVIDIA 呈現未來藍圖.

NVIDIA 創辦人兼執行長 Jensen Huang 在拉斯維加斯 Fontainebleau 舞台開啟 CES 2026, 宣布 Rubin——NVIDIA 首個極致共同設計的六晶片 AI 平台——以及用於醫療、機器人與自動駕駛的開放模型, 並展示搭載 AI 定義駕駛的 Mercedes-Benz CLA…

– 貼地一點的, 發布最新 NVIDIA DLSS 4.5更新, 最大更新之一是引入了第二代 Transformer 模型以實現超解析度 , 引入 Dynamic Multi Frame Generation、新 6X Multi Frame Generation 模式, 與先前的模型相比, 該模型的運算能力提高了五倍,並且是在大幅擴展的高保真資料集上進行訓練的

另外 亦有發布 NVIDIA RTX 在 PC 上加速 4K AI 影片生成支援 – RTX-powered video generation pipeline , 包括最新由Lightricks 發布的 AI影片生成模型 LTX-2 model

NVIDIA 宣布一系列針對 GeForce RTX、NVIDIA RTX PRO 與 NVIDIA DGX Spark 裝置的 AI 升級, 解鎖開發者在 PC 上部署生成式 AI 所需的效能與記憶體.

KLING Image O1 model released

【AI影片生成 – Kling Image O1模型推出】

內地AI生成圖片及影片的 KLING AI (快手可靈) 發布最新 Kling Image O1 model, (Omni Image 1.0 ) 強調 – 新引擎、完整指令、完全控制 !!

新版功能包括:

– High Feature Retention 高特徵保留率 (從高達 10 張參考影像中提取)

– Precise Detail Modification 精準細節修改(透過文字指令)

– Precise Control of Style and Tone 風格與色調控制的準確性

– Rich Imagination 豐富的想像力融合(例如,改變服裝、添加元素或重新風格化)

~~ 官網同時推出 Kling Omni 發布星期限時優惠 , 首年訂閱”半價” !!

Introducing Runway Gen-4.5

【Runway最新生成影片模型Runway Gen-4.5】

Runway Research 公布推出 Runway Gen-4.5 , 官方表示被描述為全球評分最高的影片模型, 提供前所未有的視覺保真度與創作控制 .

Runway Gen-4.5 能產生 cinematic 且高度逼真的輸出, 此模型在 pre-training data efficiency 與 post-training techniques 方面實現重大進展, 它為 dynamic、controllable action generation、temporal consistency 以及多樣生成模式的精準可控性設定全新標準.

所有現有控制模式(Image to Video、Keyframes、Video to Video 等)將逐步引入 Gen-4.5 .

~ 兩年前 Runway 發布 Gen-1, 直到現在使影片模型更強大且更可控, 從 base model 的重大改進到全新控制機制與 general in-context capabilities.

>> Runway Gen-4.5 的主要特點 : 前所未有的物理準確度與視覺精準 (Unprecedented Physical Accuracy and Visual Precision); 複雜場景(Complex Scenes) ; 細節構圖(Detailed Compositions) ; 物理準確度 (Physical Accuracy); 表情角色 (Expressive Characters) 及 廣泛美學處理 (Wide Range of Aesthetics)等等

官方還未正成開放 , 表示正逐步推出 Runway Gen-4.5 的存取權限, 將在未來幾天內對所有人開放 !!

FLUX.2 is here

【免費下線AI生成模型 FLUX.2 推出】

自Black Forest Labs推出 FLUX.1 推出以來, 已成免費離線AI生成圖像及影片定下了高品質的標準, 到日前終於推出最新 FLUX.2 , 官方表示這是專為真實世界創作工作流程而設計, 而非僅限於展示或娛樂用途. 它能生成高品質影像, 同時維持跨多張參考影像的角色與風格一致性, 遵循結構化提示、讀寫複雜文字、遵守品牌指南, 並可靠處理燈光、布局與Logo . FLUX.2 更能在高達 4 megapixels 的解像度下編輯影像, 同時保留細節與一致性 !

FLUX.2 主要特點包括 Multi-Reference 支援 , 更高的細節、更銳利的紋理 , 複雜排版文字生成, 加強 Prompt改善 , 更接地於真實世界知識 及 影像編輯支援高達 4 megapixels 解像度等等 !!

現提供FLUX.2 [pro] / FLUX.2 [flex] 及FLUX.2 [dev] 三個模型下載 , 亦表示即將推出輕量級模型版本 FLUX.2 [klein]

Meta Introducing SAM3 & SAM 3D

【Meta的AI模型-SAM3及SAM 3D發表】

Meta 早前發布最新 Segment Anything Model 3 (SAM 3) , 以及全新的 SAM 3D – 物理世界影像的強大 3D 重建工具 !!

去年已介紹過Meta 的SAM 2, 是一個統一模型,用於影像與影片中物件的偵測、分割與追蹤,支持文字、範例與視覺 prompt, 新的 SAM 3 支持 promptable concept segmentation , 讓使用者以文字 prompt(開放詞彙的短名詞片語)或影像範例 prompt 偵測與分割概念 , 克服固定標籤集的限制 , 而它整合 SAM 1 與 SAM 2 的視覺prompt , 如 masks、boxes 與 points .

Meta 同時推出 SAM 3D – 物理世界影像的強大 3D 重建工具, 是 SAM 模型系列的首個創新成員, 為自然影像帶來常識性的 3D 理解 ,

發布已包括 SAM 3D Objects 與 SAM 3D Body 的模型 checkpoints 等模型下載 !!

SAM 3

SAM 3D